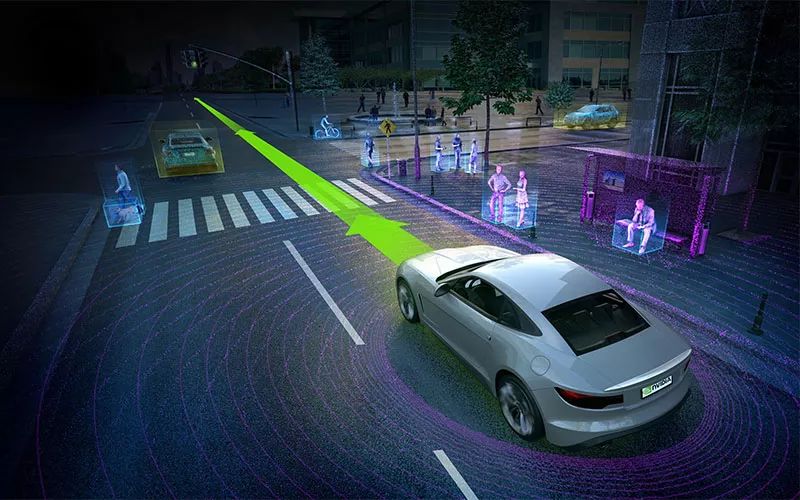

从一句话生成一张图,到几秒钟生成一段视频,生成式人工智能正在走向更复杂的真实世界应用。模型越大、分辨率越高、生成内容越丰富,对算力与能耗的需求就越惊人。然而,当前光电芯片仍主要擅长加速判别类任务,距离支撑前沿大规模生成模型还有不小距离。如何让下一代算力光芯片能运行复杂生成模型?日前,记者从上海交通大学获悉,该校集成电路学院陈一彤课题组在新一代算力光芯片方向取得重大突破,首次实现支持大规模语义视觉生成模型的全光计算芯片LightGen。相关研究近日发表于国际学术期刊《科学》上。

所谓“光计算”,可以通俗理解为:不是让电子在晶体管中运行,而是让光在芯片中传播,用光场的变化完成计算。光天然具备高速和并行的优势,因此长期被视为突破算力与能耗瓶颈的重要方向。然而,要把光计算真正用到生成式AI上,并非这么简单:生成模型往往规模更大,还需要在不同维度之间不断变换;如果芯片规模较小,则不得不频繁在光与电之间级联或复用,速度优势也会被延迟与能耗迅速抵消。因此,全光计算就显得更为重要和困难。

LightGen之所以能够实现惊人的性能飞跃,在于它在单枚芯片上同时突破了三项领域公认的关键瓶颈:单片上百万级光学神经元集成、全光维度转换、不依赖真值的光学生成模型训练算法。这三项中的任意一项单独突破都足以构成重要进展,而LightGen将它们同时实现,使得面向大规模生成任务的全光端到端实现成为可能。

更重要的是,LightGen展示的并不是电辅助光去做生成,而是让全光芯片完整实现“输入—理解—语义操控—生成”的闭环:输入图像进入芯片后,系统能够提取与表征语义信息,并在语义操控下生成全新的媒体数据,实现让光“理解”和“认知”语义。论文实验验证,LightGen可完成高分辨率图像语义生成、3D生成、高清视频生成及语义调控,同时支持去噪、局部与全局特征迁移等多项大规模生成式任务。

业内专家评价,LightGen为新一代算力芯片真正助力前沿人工智能开辟了新路径,也为探索更高速、更高能效的生成式智能计算提供了新的研究方向。

郑重声明:智慧观察发布此信息的目的在于传播更多信息,与本站立场无关。若内容涉及投资建议,仅供参考勿作为投资依据。投资有风险,决策需谨慎。

- 新一代光计算芯片研究获突破2025-12-22

- 规范汽车企业促销与定价行为2025-12-22

- 撬动万亿,冰雪经济何以滚烫?2025-12-19

- 黄金以旧换新经营服务迎新规2025-12-17

- 深耕蔚蓝壮大海洋新兴产业2025-12-17

- 白酒龙头率先打响“稳价保卫战”2025-12-16

- 下一篇:规范汽车企业促销与定价行为

- 最新推荐